Fake-News erkennen und bekämpfen: So prüfen Sie Quellen und Inhalte

Mit KI erzeugte Bild- und Videomontagen, um bewusst Personen oder Informationen zu fälschen oder zu manipulieren, lassen sich im Internet schnell verbreiten. Fragen Sie sich deshalb immer: Ist das echt oder nicht?

Fake-News sind erfundene Fakten. Dazu zählen zum Beispiel falsche Zitate von prominenten Personen oder Politikern, die ihnen Meinungen oder Aussagen zuschreiben, die sie nie gesagt haben. Gerüchte oder Spekulationen werden als Fakten präsentiert, ohne dass eine seriöse Quelle oder ein Nachweis d...

Fake-News sind erfundene Fakten. Dazu zählen zum Beispiel falsche Zitate von prominenten Personen oder Politikern, die ihnen Meinungen oder Aussagen zuschreiben, die sie nie gesagt haben. Gerüchte oder Spekulationen werden als Fakten präsentiert, ohne dass eine seriöse Quelle oder ein Nachweis dafür angegeben wird.

Manipulierte Bilder oder Videos verfälschen Ereignisse oder reißen sie aus dem Kontext, um eine bestimmte Botschaft zu vermitteln. Verschwörungstheorien bieten ohne Beweise alternative Erklärungen für historische oder aktuelle Ereignisse an, oft mit dem Ziel, Angst oder Misstrauen zu schüren.

Vor allem im US-Wahlkampf, beim Konflikt im Gazastreifen und bei der russischen Kriegspropaganda sind gezielte Desinformationen an der Tagesordnung. Gleich, ob X (ehemals Twitter), Facebook, TikTok oder vermeintliche Nachrichtenportale – mit manipulierten Texten und Bildern werden Menschen in ihrer Meinung beeinflusst.

Fake-News sind eine große Gefahr für unsere Gesellschaft. Mit falschen oder irreführenden Infos lassen sich Meinungen beeinflussen, Emotionen auslösen oder Leute finanziell schädigen. Dabei können Fake-News ganz verschiedene Formen annehmen, wie Texte, Bilder, Videos, Audioaufnahmen oder soziale Medien-Posts.

Doch inzwischen geht es nicht mehr nur darum, mit einem oft reißerischen oder sensationellen Ton falsche Informationen zu verbreiten und etwa Personen oder Parteien zu diskreditieren. Immer mehr Kriminelle machen sich Fake-News und entsprechende Techniken bei Bildern, Videos und Stimmen zu eigen, um Geld der arglosen Opfer zu ergaunern.

Um Fake-News zu erkennen, sollten Sie immer die Glaubwürdigkeit der Quelle, den Inhalt und den Kontext überprüfen und mehrere Informationskanäle nutzen. Ein gutes Beispiel für eine Fake-News ist ein Satz über Fake-News:

Seit Jahrzehnten wird dem britischen Staatsmann und Schriftsteller Winston Churchill (1874-1965) das Zitat „Ich glaube nur der Statistik, die ich selbst gefälscht habe …“ zugeordnet. Nach umfangreichen Recherchen (unter anderem vom Statistischen Landesamt Baden-Württemberg) lässt sich heute mehr denn je sagen: Nichts spricht für die Richtigkeit des Zitats von Churchill – aber alles spricht dagegen.

Achten Sie in Texten und Bildern auf folgende Merkmale

Eine der häufigsten Arten von Fake-News sind falsche oder irreführende Texte, die als Nachrichtenartikel getarnt sind. Solche Texte können erfundene oder verzerrte Fakten enthalten, die eine bestimmte Agenda verfolgen oder die Öffentlichkeit täuschen wollen. Um solche Texte zu erkennen, sollte Sie diese Punkte beachten:

- Quelle: Überprüfen Sie die Quelle des Textes. Ist es eine seriöse und vertrauenswürdige Nachrichtenseite oder ein Blog, der sich als Nachrichtenseite ausgibt? Hat die Seite ein Impressum, ein Kontaktformular oder ein Redaktionsteam? Wie ist die URL der Seite? Enthält sie verdächtige Zeichen oder Rechtschreibfehler?

- Inhalt: Überprüfen Sie den Inhalt des Textes. Ist er gut recherchiert und sind die Fakten mit Quellen belegt? Gibt es Zitate von Experten, Augenzeugen oder offiziellen Stellen? Sind die Fakten konsistent und aktuell? Gibt es auffällige Grammatik- oder Rechtschreibfehler? Ist der Ton des Textes sachlich und neutral oder emotional und voreingenommen?

- Kontext: Überprüfen Sie den Kontext des Textes. Passt er zu dem, was andere seriöse Quellen über das Thema berichten? Gibt es Widersprüche oder Unstimmigkeiten? Ist der Text datiert und zeitgemäß? Handelt es sich um eine Satire, eine Meinung oder eine Tatsachenbehauptung?

- Absender: Bevor Sie Videos, Bilder oder Nachrichten glauben, schauen Sie sich an, wer sie gepostet hat. Ist er oder sie der Schöpfer oder sind sie schon oft geteilt worden? Ein echter Name kann ein Hinweis darauf sein, dass ein Account echt ist. Überprüfen Sie das Impressum auf Websites. Es sollte einen Verantwortlichen für die Inhalte und eine Adresse zeigen, nicht nur eine anonyme E-Mail.

Mögliche Fake-News im Netz auf ihre Echtheit prüfen lassen

Um Fake-News zu erkennen, sollten Sie immer mehrere Informationskanäle nutzen und den Inhalt kritisch hinterfragen. Wenn Sie Zweifel an der Glaubwürdigkeit eines Textes haben, können Sie auch spezielle Websites oder Apps nutzen, um die Nachricht zu überprüfen und zu bewerten, wie Mimikama (www.mimikama.org). Der Europäische Auswärtige Dienst (EAD) listet auf EUvsDisinfo.eu aktuelle Fälle von Desinformation aus Russland auf – und widerlegt auf der Webseite auch falsche Behauptungen dazu.

Manipulierte Bilder und Videos entstehen in Sekunden

Hier ein Bild vom Papst im Balenciaga-Daunenmantel, da die Trauung von Elon Musk und Mark Zuckerberg und dort die Bundesregierung als Obdachlose unter einer Brücke. Immer mehr täuschend echte Fake-Bilder fluten das Internet. Fake-Bilder sind Bilder, die mithilfe von digitalen Techniken manipuliert oder generiert wurden, um eine falsche oder irreführende Realität darzustellen.

Fake-Bilder können verschiedene Zwecke haben, wie Unterhaltung, Kunst, Propaganda, Desinformation oder Erpressung. Um Fake-Bilder zu erstellen, benötigt man spezielle Software und Kenntnisse, je nachdem, wie realistisch und überzeugend das Ergebnis sein soll.

Eine gängige Methode ist die Verwendung von Deepfakes (von Deep Learning und Fake). Dahinter stecken KI-basierte Algorithmen. Deepfakes nutzen neuronale Netze, die aus großen Datenmengen lernen, wie man die Merkmale und Bewegungen einer Person täuschend echt imitiert.

Dafür benötigt man eine funktionierende Deepfake-Software und genügend Bild- oder Videomaterial der beteiligten Person. Die ersten halbwegs brauchbaren Deepfakes sind 2017 bei Reddit aufgetaucht. Beim sogenannten Face-Swapping wurden in Videos oder Fotos die Gesichter von beliebigen Personen durch das Gesicht anderer Personen ersetzt.

In der Regel waren das meist weibliche Prominente, die dann in Pornosequenzen auftauchten. Auf dem inzwischen gesperrten Subreddit Deepfakes wurden innerhalb weniger Monate mehr als 50.000 Deepfake-Videos ausgetauscht – vorwiegend Pornos. Auf Basis des Open-Source-Codes wurde die Technik weiterentwickelt. Mit der Software DeepFaceLab lassen sich mit wenigen Mausklicks die Gesichter von Personen austauschen.

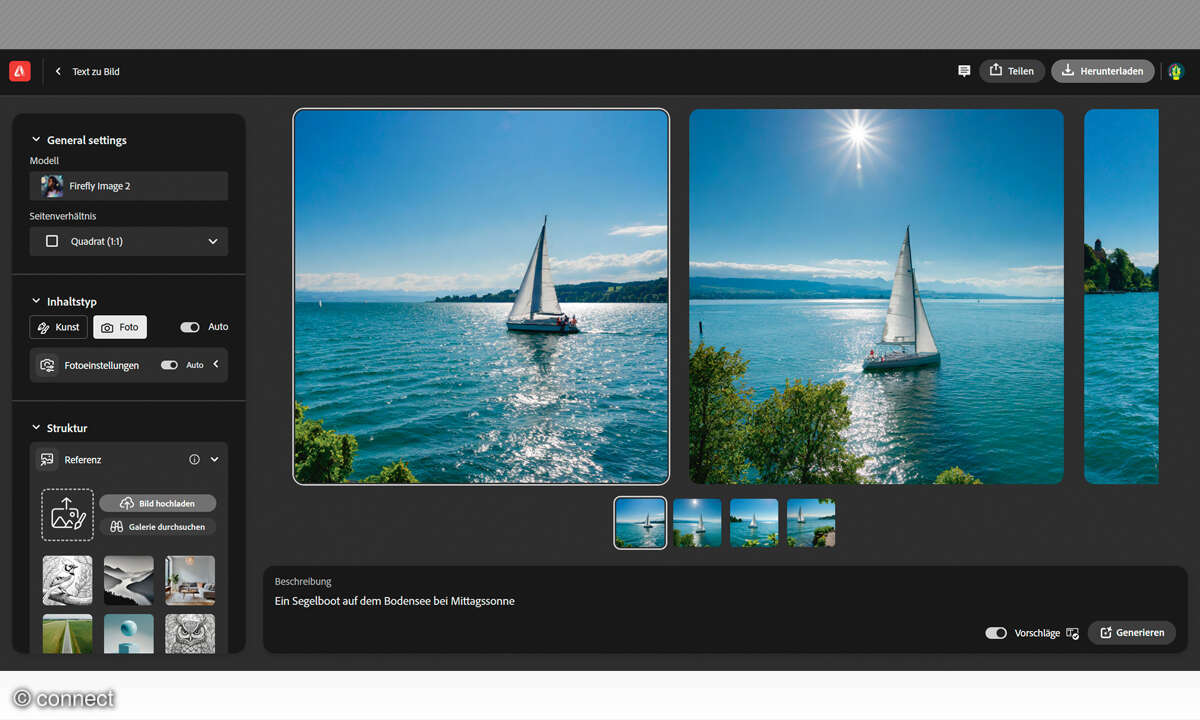

Eine andere Methode, um Fake-Bilder zu erzeugen, ist die Verwendung von Generative Adversarial Networks (GANs), wie sie zum Beispiel bei Adobe Photoshop oder Firefly zum Einsatz kommen. GANs sind ebenfalls auf künstlicher Intelligenz basierende Algorithmen, die in der Lage sind, neue Bilder zu erzeugen, die nicht von echten Bildern zu unterscheiden sind. GANs bestehen aus zwei konkurrierenden Netzwerken, die sich gegenseitig verbessern: einem Generator, der neue Bilder erzeugt, und einem Diskriminator, der versucht, zwischen echten und gefälschten Bildern zu unterscheiden.

Tipp: Ein nützlicher Hinweis, um herauszufinden, ob ein Foto echt oder gefälscht ist, ist die Bilder-Rückwärtssuche: Dabei wird die Bilddatei oder die URL auf der Seite einer Suchmaschine hochgeladen und nach Informationen zu Ort und Datum der Veröffentlichung im Internet gesucht. So kann man auch überprüfen, ob ein Bild tatsächlich aktuell ist oder vielleicht schon früher veröffentlicht wurde, eventuell in einem ganz anderen Kontext.

Hinweise für gefakte Bilder: Wenn Sie genau hinsehen, gibt es fehlerhafte Proportionen zwischen den Körperteilen, bei Händen stimmt oft die Zahl der Finger nicht, und auch bei den Lichteinstrahlungen, Schatten und Spiegelungen treten möglicherweise Fehler auf. Wenn Sie das Bild größer ziehen, sehen Sie oft Ränder, wo keine sein dürften.

Um die Herkunft von Bildern nachvollziehbarer zu machen, arbeitet Adobe seit einiger Zeit an einem neuen Konzept. Die Content Authenticity Initiative, die Adobe 2019 ins Leben gerufen hat, will einen Branchenstandard schaffen, mit dem man erkennen kann, ob Bilder manipuliert wurden. In Adobe-Software generierte Bilder werden mit einer Art unsichtbarer Kennzeichnung versehen. Ein kleines Symbol soll dann signalisieren: Hier gibt es mehr Informationen über das Bild.

Die Teilnahme ist freiwillig, viele Medienorganisationen machen bereits mit, wie die New York Times, die BBC oder die Deutsche Presse-Agentur (dpa). Aber auch Kamerahersteller wie Leica oder Tech-Firmen wie Microsoft sind beteiligt.

Täuschend echte Stimmen imitieren

Wer kennt sie nicht, die Stimmenimitatoren im Radio, die in die Rolle vom Prominenten schlüpfen und Nonsens verbreiten. Was in den meisten Fällen noch lustig ist, kann aber mit KI auch für kriminelle oder unlautere Zwecke missbraucht werden.

Ein bekanntes Beispiel dafür ist der Fall eines britischen Unternehmers. Er wurde Opfer einer perfiden Telefonbetrugsmasche: Mithilfe einer KI wurde seine Stimme imitiert, um einen arglosen Mitarbeiter anzuweisen, eine dringende Überweisung in Höhe von 220.000 Euro zu tätigen. Erst später stellte sich der Fake heraus.

Kriminalhauptkommissar Hans Hülsbeck vom Landeskriminalamt (LKA) Nordrhein-Westfalen warnte jüngst vor einer neuen Stufe des Enkeltricks: „Bei KI-basierten Stimmen fällt es dem Bürger sehr, sehr schwer, diesen Unterschied überhaupt noch zu erkennen. Das kann also ganz einfach sein, dass jetzt die Stimme der Enkelin oder des Enkels KI-basiert nachgemacht wird.“

Die Voraussetzung ist natürlich, dass die Betrüger über Audio-Aufzeichnungen von der Stimme des Enkels oder der Enkelin verfügen, mit denen sie die KI füttern können. Mit Reels bei Facebook und Instagram und TikTok bekommen Kriminelle das oft genug frei Haus geliefert.

Zum Imitieren von Stimmen gibt es verschiedene KI-Technologien, die auf der Analyse und Synthese von Sprachsignalen basieren. Eine davon ist das Voice Cloning, bei dem eine KI versucht, die Stimme einer bestimmten Person anhand einiger Beispiele nachzuahmen. Mit Voice Cloning kann man nicht nur die Sprachmelodie und den Akzent, sondern auch die individuellen Eigenheiten wie Stimmbruch oder Lispeln kopieren.

So kann man zum Beispiel einem Prominenten Worte in den Mund legen, die er nie gesagt hat, oder persönliche Gespräche mit Menschen führen, ohne dass sie merken, dass sie mit einer Maschine sprechen.

Voice Cloning kann für viele harmlose oder sogar nützliche Zwecke eingesetzt werden, wie für das Synchronisieren von Filmen, das Erstellen von Hörbüchern oder das Personalisieren von Sprachassistenten.

Eine Stimme, die echt klingt, kann gefälscht sein

Zum Schutz vor Angriffen mit manipulierten Stimmen ist es wichtig, sich stets bewusst zu sein, dass Stimmen nicht mehr eindeutig einer Person zugeordnet werden können. Daher ist es unerlässlich, immer eine zweite Bestätigung zu verlangen, bevor Sie etwa sensible Informationen preisgeben oder gar finanzielle Transaktionen durchführen. Außerdem sollten Sie darauf achten, ob die Stimme ungewöhnlich klingt, ob sie Hintergrundgeräusche hat oder ob sie Fragen ausweicht oder wiederholt.

Es gibt auch einige technische Möglichkeiten, um gefälschte Stimmen zu erkennen, wie Spektralanalyse, Wasserzeichen oder digitale Signaturen, die aber noch nicht sehr verbreitet sind. Daher ist es auch notwendig, dass es klare ethische Richtlinien und rechtliche Rahmenbedingungen für den Einsatz von Voice Cloning gibt, um den Missbrauch zu verhindern und die Privatsphäre und die Urheberrechte der Sprecher zu schützen.

Fazit: Fake-News lauern überall

Von KI erzeugte Bilder, Stimmen und Videos sind auf den ersten Blick täuschend echt. Begegnen Sie Nachrichten, Bildern und Videos deshalb immer mit einer gewissen Skepsis. Machen Sie nach Möglichkeit einen Faktencheck.

Info: Kennzeichnung KI-generierter Inhalte

In sozialen Netzwerken kursieren Millionen Fake-News – gleich, ob Texte, Bilder und Videos. Daher forderte die Europäische Union die Betreiber der Dienste schon länger auf, mehr Ressourcen für die Überprüfung von Inhalten einzusetzen.

Um dem Ganzen Nachdruck zu verleihen, gibt es seit dem 25. August 2023 das EU-Gesetz über digitale Dienste (DSA). Die Unternehmen, die den EU-Verhaltenskodex unterschrieben haben, sollen gegen Falschinformationen vorgehen und ihre Maßnahmen offenlegen. Dazu zählen unter anderem Fake-Accounts, Faktenchecks und deren Wirkung. Zu den Unterzeichnern gehören etwa Google, TikTok, Microsoft sowie Meta (Facebook und Instagram). X (Twitter) hat sich zurückgezogen.

EU-Gesetz über künstliche Intelligenz

Parallel hat die EU den AI Act (Artificial Intelligence Act) auf den Weg gebracht. Er wurde von der Europäischen Kommission am 21. April 2021 vorgeschlagen und am 13. März 2024 verabschiedet. Nach der Übergangsfrist soll er ab April 2026 verbindlich sein. Die Vorschriften über GPAI-Modelle, Governance und Sanktionen sollen jedoch bereits zwölf Monate nach der Verabschiedung gelten.

Das EU-Gesetz über künstliche Intelligenz zielt darauf ab, KI-Anwendungen auf der Grundlage ihres Risikos, Schaden zu verursachen, zu klassifizieren und zu regulieren. Diese Klassifizierung umfasst vier Risikokategorien (inakzeptabel, hoch, begrenzt und minimal) sowie eine zusätzliche Kategorie für KI für allgemeine Zwecke.

Info: Retusche, Memes und echte Fakes

Jüngst sorgte ein Familienbild der englischen Royals für Aufsehen. Ohne böse Absichten hatte Prinzessin Kate ein Foto bearbeitet und damit Spekulationen über ihren Gesundheitszustand befeuert. Manipulierte Fotos sind nicht neu.

Mein Vater hat in den 1960er- und 1970er-Jahren beim Burda-Verlag in Offenburg als Farbretuscheur gearbeitet – ein längst ausgestorbener Beruf. Mit Chemie, Pinsel und anderen Werkzeugen hat die Abteilung Fotoabzüge bearbeitet und so etwa der Queen einen blauen statt einen roten Hut verpasst (sein Lieblingsbeispiel) oder auch störende Personen und Gegenstände entfernt

Oft lustig, manchmal auch verletzend sind Memes. Das sind Fotos oder Videos, die bekannte Personen veräppeln oder imitieren. Diese Memes werden via WhatsApp und Facebook oft millionenfach geteilt. Dazu kommen noch echte Fake-Bilder, die mit dem Ziel einer bewussten Irreführung entstanden sind. Sie werden oft von Kriegsparteien und für Propagandazwecke genutzt. Das Problem und die Gefahr, die wir heute haben: Mit Photoshop & Co. kann jeder Bilder manipulieren – und zwar inzwischen so gut, dass die Fake-Bilder kaum noch als solche zu erkennen sind.

FAQ zu Fake-News

Was sind Fake-News?

Fake-News sind erfundene oder manipulierte Informationen, die als wahr dargestellt werden. Dazu gehören falsche Zitate, Gerüchte, Spekulationen, manipulierte Bilder und Videos sowie Verschwörungstheorien.

Welche Arten von Fake-News gibt es?

Fake-News können verschiedene Formen annehmen:

- Erfundene Fakten: Falsche Zitate oder Meinungen von Prominenten oder Politikern.

- Manipulierte Medien: Bilder oder Videos, die verfälscht oder aus dem Kontext gerissen sind.

- Verschwörungstheorien: Unbewiesene alternative Erklärungen für Ereignisse, die Angst oder Misstrauen schüren.

- Falsche Nachrichtenartikel: Texte, die erfundene oder verzerrte Fakten enthalten und als echte Nachrichten getarnt sind.

Warum sind Fake-News gefährlich?

Fake-News können Meinungen beeinflussen, Emotionen auslösen und Menschen finanziell schädigen. Sie stellen eine Bedrohung für die Gesellschaft dar, da sie Vertrauen untergraben und Fehlinformationen verbreiten.

Wo treten Fake-News häufig auf?

Sie finden sich oft auf sozialen Medien wie Facebook, TikTok und X (ehemals Twitter) sowie auf vermeintlichen Nachrichtenportalen.

Wie kann ich Fake-News erkennen?

Um Fake-News zu erkennen, sollten Sie folgende Punkte überprüfen:

- Quelle: Ist die Quelle seriös und vertrauenswürdig? Hat die Seite ein Impressum und ein Redaktionsteam?

- Inhalt: Sind die Fakten gut recherchiert und belegt? Gibt es Zitate von Experten und offizielle Stellen? Ist der Ton sachlich?

- Kontext: Passt der Text zu Berichten anderer seriöser Quellen? Gibt es Unstimmigkeiten oder Widersprüche?

- Absender: Wer hat das Video oder Bild gepostet? Ist der Absender vertrauenswürdig und nachvollziehbar?

Wie entstehen manipulierte Bilder und Videos?

Manipulierte Bilder und Videos werden oft mit speziellen Softwaretools erstellt. Technologien wie Deepfakes nutzen KI-basierte Algorithmen, um täuschend echte, aber falsche Darstellungen zu erzeugen.

Was sind Deepfakes?

Deepfakes sind mithilfe von Künstlicher Intelligenz erstellte Videos oder Bilder, bei denen das Gesicht oder die Stimme einer Person täuschend echt imitiert wird. Diese Technik wird oft missbraucht, um Personen in kompromittierende Situationen zu bringen oder um Fake-Nachrichten zu verbreiten.

Wie kann ich überprüfen, ob ein Bild oder Video echt ist?

- Nutzen Sie die Bilder-Rückwärtssuche, um die Herkunft und das Veröffentlichungsdatum eines Bildes zu überprüfen.

- Achten Sie auf Fehler in Proportionen, Lichteinstrahlungen, Schatten und Spiegelungen.

- Prüfen Sie, ob die Stimme ungewöhnlich klingt, Hintergrundgeräusche hat oder Fragen ausweicht.

Gibt es technische Lösungen zum Erkennen von Fake-News?

Ja, es gibt spezielle Websites und Apps wie Mimikama, die helfen, die Echtheit von Nachrichten zu überprüfen. Der Europäische Auswärtige Dienst bietet auf EUvsDisinfo.eu Informationen über Desinformation und deren Widerlegung.

Was tut die EU gegen Fake-News und KI-Manipulationen?

Die EU hat das Gesetz über digitale Dienste (DSA) und den AI Act verabschiedet, um gegen Fake-News und Missbrauch von Künstlicher Intelligenz vorzugehen. Diese Gesetze verpflichten Unternehmen, gegen Falschinformationen vorzugehen und ihre Maßnahmen offen zu legen.